从贝叶斯说起

begin with bayes

$$P(A|B)=\frac { P(A\cap B) }{ P(B) } =\frac { P(B|A)\cdot P(A) }{ P(B) }$$

简单得令人尴尬

Embarrassedly Simple

基本上就是数数

Basically you just Counts

垃圾邮件过滤

Spam Filter

朴素贝叶斯

Naive Bayes

马尔科夫链

Markov Chain

自然语言生成

Natural Language Generator

贝叶斯的局限

Limits of Bayes

无法捕捉输入间关系

Unable capture relations between input

需要大量的数据

Quadratic increase with feature dimensions

神经网络

Neural Network

$$ \begin{pmatrix} x_0 & x_1 & x_2 & x_3 & \cdots & x_n \\ \end{pmatrix} \cdot \begin{pmatrix} w_{0,1} & w_{0,2} \\ w_{1,1} & w_{1,2} \\ w_{2,1} & w_{2,2} \\ w_{3,1} & w_{3,2} \\ \vdots & \vdots \\ w_{n,1} & w_{n,2} \\ \end{pmatrix} = \begin{pmatrix} z_1 & z_2 \\ \end{pmatrix} $$

$$ \begin{pmatrix} a_1 & a_2 \end{pmatrix} = \begin{pmatrix} sigmoid(z_1) & sigmoid(z_2) \end{pmatrix} $$

$$

sigmoid(t) = \frac{1}{1+e^{-t}}

$$

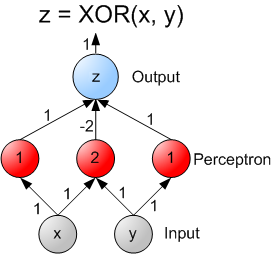

异或函数

XOR

$$ \quad X \quad \quad Y \\ \begin{eqnarray} 0\quad 0 & = & 0 \\ 0\quad 1 & = & 1 \\ 1\quad 0 & = & 1 \\ 1\quad 1 & = & 0 \end{eqnarray} $$

代价函数

Cost Function

$$ J(\Theta )=\frac { 1 }{ m } \left[ \sum _{ i=1 }^{ m }{ \sum _{ k=1 }^{ K }{ { y }_{ k }^{ (i) }log({ h }_{ \Theta }({ x }^{ (i) }))_{ k }+(1-{ y }^{ (i) })(1-(h_{ \Theta }(x^{ (i) }))_{ k }) } } \right] \\ +\frac { \lambda }{ 2m } \sum _{ l=1 }^{ L-1 }{ \sum _{ i=1 }^{ s_{ l } }{ \sum _{ j=1 }^{ s_{ l }+1 }{ (\Theta _{ ij }^{ (l) })^{ 2 } } } } $$

Gradient Descent

梯度下降

BackPropagation

反向传播算法

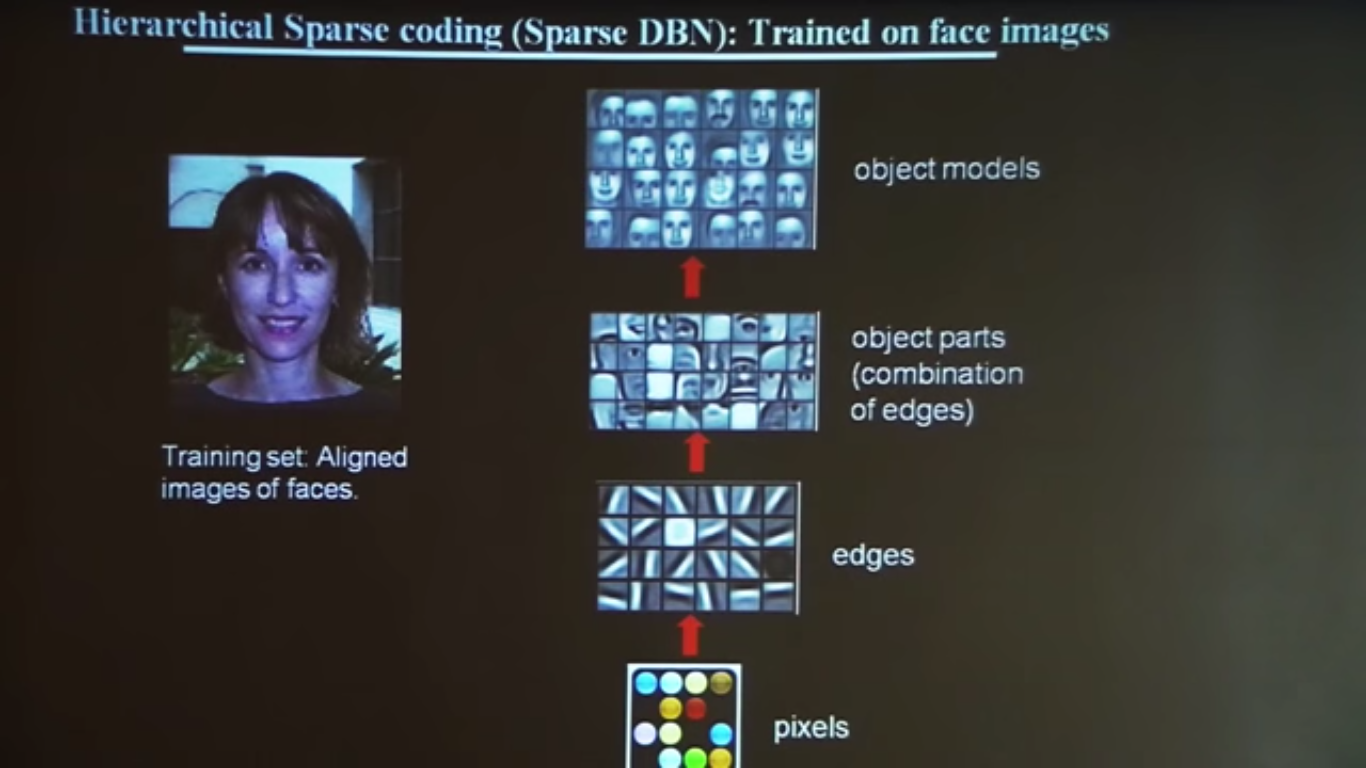

十亿链接

1 billion connections

一千万200x200像素图片

10 million 200x200 pixel images

一千台机器(一万六千颗核心)

1,000 machines (16,000 cores)

跑了三天

three days

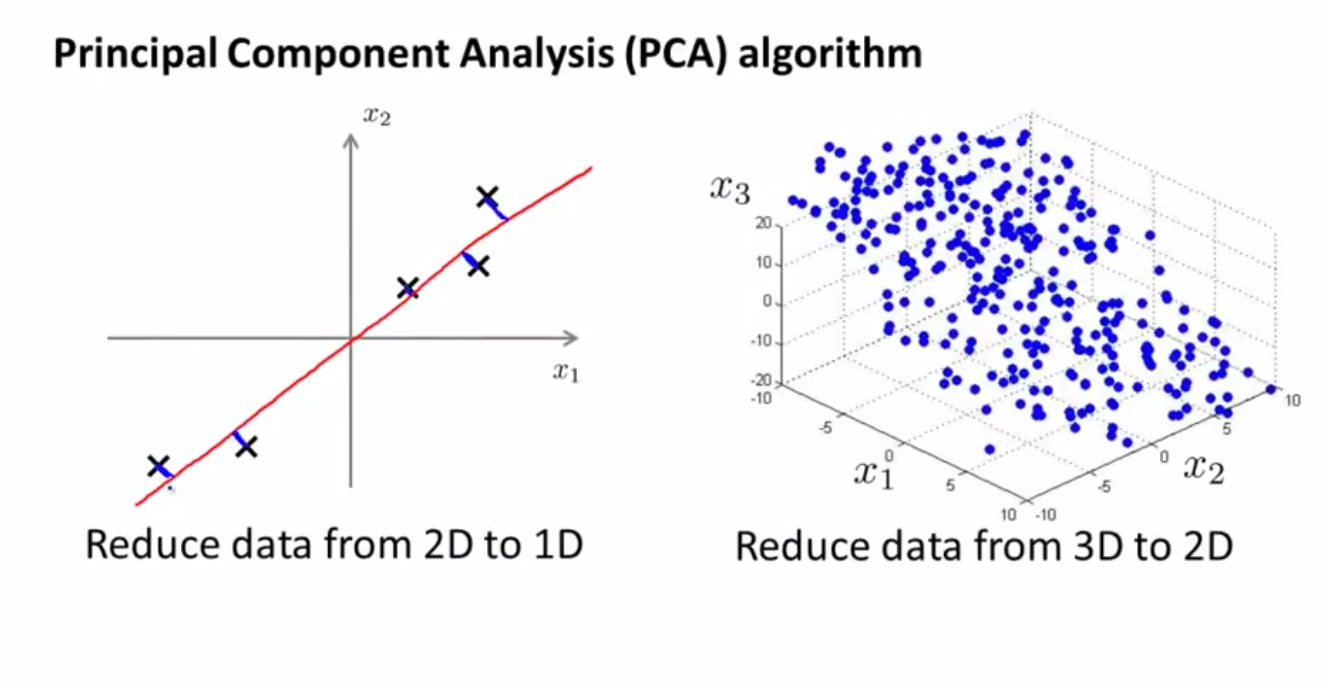

维度的祝福与诅咒

The Bless and Curse of Dimensionality

主成分分析

Principal Component Analysis (PCA)

自动编码器

AutoEncoder

聚类算法

Clustering Algorithms

- K值平均 K-means

- 邻近算法 K nearest neighbours

- 谱聚类 Spectral Clustering

- 密度峰 Density Peak